Сегодня больше тысячи человек собралось в бизнес-центре отеля «Виктория» на конференцию AI-MEN, которая целиком и полностью посвящена искусственному интеллекту. На мероприятии выступали спикеры из Oxagile, Synesis, Targetprocess и других компаний.

Ведущий инженер Visper Project в Synesis Дмитрий Клименков рассказал о медицинском и в то же время социальном проекте. По словам спикера, во всем мире живет около ста тысяч человек, перенесших ларингоэктомию — операции по удалению голосовых связок. Говорить они не могут, а общение через мессенджеры получается сложным из-за того, что основная масса таких людей — старшего поколения, возрастом за пятьдесят.

Решения для них существуют, но это скорее «костыли». К примеру, вживляется аппарат, который имитирует речь с помощью выдыхаемого грудного воздуха — голос получается механическим и сложным для понимания. Более того, подобные методы общения требуют практики для самого пациента, а учиться хотят далеко не все.

В Synesis подошли к проблеме с другой стороны. Компания работает над нейросетью, которая распознает артикуляцию через камеру смартфона. Вычисления происходят на самом устройстве, поэтому время обработки сильно зависит от «железа»: например, на Xiaomi 2015 года распознавание занимает порядка восьми секунд, но с более свежими и производительными девайсами скорость будет заметно выше.

Проект нишевый, и мелким стартапам нет большого смысла браться за него — аудитория в сто тысяч человек маленькая, заработать особо не выйдет. Расширить базу клиентов за счет глухонемых людей не получится — у них, говорит Дмитрий, обычно сильно нарушена артикуляция, и нейросети приходится туго.

Распознавание речи по губам наверняка интересует и силовые структуры по всему миру, но представитель Synesis успокоил: разработка такой системы получится слишком дорогой, к тому же «есть более дешевые способы извлечь из человека информацию». Прозвучало прямо в духе героя Рассела Кроу в «Совокупности лжи».

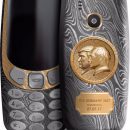

Что до общих трендов искусственного интеллекта, то независимый бизнес-консультант Никита Филимонов выделил угрозу deepfake — систему наложения изображений на исходник с целью искажения информации. Как гласит осточертевшая фраза — «технологии развиваются», а значит, распознавать deepfake станет все сложнее.

|

|